نخستین وزیر هوش مصنوعی جهان در دولت آلبانی: راهی برای مهار فساد یا نمایشی پرخطر؟

یک استراتژی هوشمندانه برای نمایش شفافیت یا یک ریسک بزرگ؟ اگر به درستی اجرا و پشتیبانی قانونی شود، ممکن است به کاهش فساد کمک کند. اما اگر بدون پشتوانه حقوقی و فنی کافی باشد، ممکن است به یک نمایش صرف تبدیل شده و اعتماد عمومی را بیش از پیش تضعیف کند. موفقیت آن به اجرا، شفافیت در عملکرد و پاسخگویی دولت بستگی دارد.

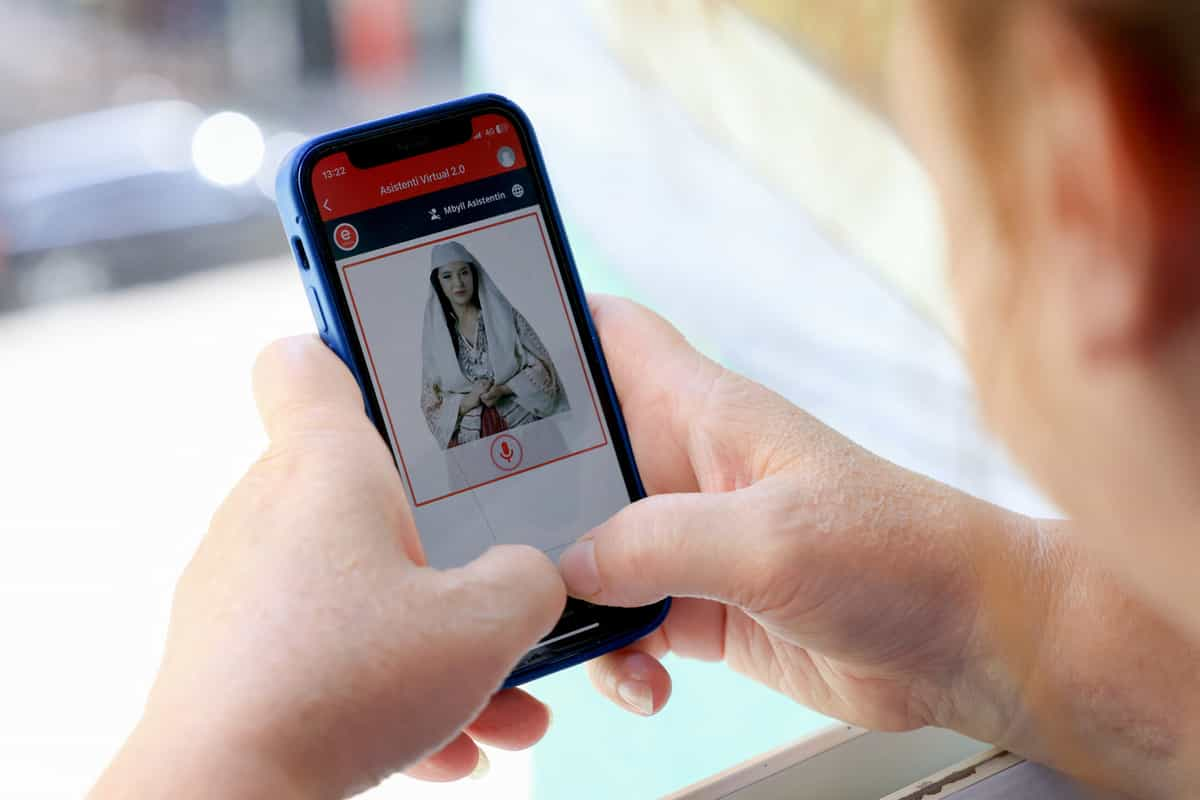

تیرانا، ۱۲ سپتامبر ۲۰۲۵. نخستوزیر آلبانی در ۱۱ سپتامبر ۲۰۲۵ اعلام کرد که آواتار هوش مصنوعی «دیلا» بهعنوان اولین وزیر کابینه «ایجادشده بهصورت مجازی» منصوب شده و مسئول نظارت بر مناقصههای عمومی خواهد بود تا فساد را کاهش دهد. (عکس از عدنان بچی / خبرگزاری فرانسه)

به گزارش خبرگزاری رویترز، ادی راما، نخستوزیر آلبانی در کابینه خود، وزیری را که توسط فنآوری هوش مصنوعی «تولید» شده، مسئول مبارزه با فساد کرد.

دیلا، که در زبان آلبانیایی به معنای «خورشید» است، پنجشنبه گذشته به این مقام منصوب شد. راما او را بهعنوان «عضوی از کابینه که بهصورت فیزیکی حضور ندارد» معرفی کرد و گفت که دیلا تضمین خواهد کرد «مناقصههای عمومی ۱۰۰ درصد عاری از فساد باشند.»

اعطای مناقصهها مدتهاست که منشأ فساد در آلبانی با دو میلیون و ۸۰۰ هزار نفر جمعیت است. دزدسالاری و فساد یکی از مهمترین موانع پیوستن آلبانی به اتحادیه اروپاست.

حزب سوسیالیست راما، که اخیراً برای چهارمین بار به قدرت رسیده، اعلام کرده که مذاکرات را تا سال ۲۰۲۷ به پایان میرساند و طی پنج سال آلبانی را به عضویت اتحادیه اروپا درمیآورد.

نمایندگان پارلمان بهزودی درباره کابینه جدید راما رأیگیری خواهند کرد، اما مشخص نیست که آیا او برای پست مجازی دیلا نیز درخواست رأیگیری خواهد کرد یا خیر.

کارشناسان حقوقی میگویند ممکن است نیاز به کار بیشتری برای تعیین وضعیت رسمی دیلا باشد که روی صفحه بهعنوان زنی با لباس سنتی فولکلور آلبانیایی نمایش داده میشود.

چالشهایی مانند مسئولیتپذیری، امنیت و خطر دستکاری، و جانبداری الگوریتمی پیش روی دیلا قرار دارند. اگر دیلا خطایی مرتکب شود، تعیین مسئول قانونی دشوار خواهد بود. همچنین، خطر دستکاری دادههای ورودی توسط بازیگران فاسد یا تقویت الگوهای فساد موجود در دادههای آموزشی وجود دارد. دیلا به عنوان یک «فیلتر هوشمند» عمل میکند که با همکاری انسانها، پروندههای مشکوک را برای بررسی نهایی ارجاع میدهد، و این مدل همکاری انسان و ماشین، آینده بهرهبرداری از هوش مصنوعی در حوزههای حساس را نشان میدهد.

گازمِند باردی، رهبر گروه پارلمانی دموکراتها، گفت که وضعیت وزارتی دیلا را غیرقانونی میداند. باردی در فیسبوک نوشت:

دلقکبازی نخستوزیر نمیتواند به اقدامات قانونی دولت آلبانی تبدیل شود.

نخستوزیر جزئیاتی درباره نظارت انسانی بر دیلا ارائه نکرد و به خطرات احتمالی دستکاری این ربات هوش مصنوعی نیز اشارهای نکرد.

برای موفقیت چنین سیستمی در محیطهای دارای فساد ساختاری، نیاز به طراحی شفاف، بازبینی مستقل توسط نهادهای بینالمللی و مشارکت جامعه مدنی است. پروژه دیلا، اگر با نظارت دقیق و چارچوبهای حقوقی قوی اجرا شود، میتواند همکاری انسان و هوش مصنوعی را بهعنوان آینده حکمرانی نشان دهد. اما بدون این پیشنیازها، خطر تبدیل هوش مصنوعی به ابزاری برای مشروعیتبخشی به فساد وجود دارد، که این امر در زمینههایی مانند ایران نیازمند توجه ویژه به مکانیزمهای جلوگیری از سوءاستفاده است.

انتصاب «دیلا»، یک هوش مصنوعی، به عنوان مسئول مبارزه با فساد در کابینه آلبانی، گامی مهم به سوی «حکمرانی الگوریتمی» است. این اقدام نشاندهنده بلوغ فنآوری هوش مصنوعی و افزایش اعتماد به آن برای مدیریت حوزههای حساسی مانند مناقصههای عمومی است. دیلا، که پیشتر تنها یک دستیار مجازی بود، اکنون با اختیارات نظارتی به یک تصمیمگیرنده رسمی تبدیل شده و مسیری جدید برای «حکمرانی دیجیتال» باز کرده است، با این امید که سیستمهای هوشمند بدون سوگیری انسانی فرآیندها را مدیریت میکنند.

دیلا اوایل امسال بهعنوان دستیار مجازی در پلتفرم خدمات عمومی e-Albania راهاندازی شد و به کاربران کمک میکرد تا در سایت گشتوگذار کنند و به حدود یک میلیون سند دیجیتال دسترسی پیدا کنند. بر اساس آمار رسمی، او تاکنون به صدور ۳۶ هزار و ۶۰۰ سند دیجیتال کمک کرده و نزدیک به ۱۰۰۰ خدمت از طریق این پلتفرم ارائه داده است. با این حال، همه متقاعد نشدهاند. یکی از کاربران فیسبوک گفت:

حتی دیلا هم در آلبانی فاسد خواهد شد.

کاربر دیگری نوشت:

دزدی ادامه خواهد یافت و دیلا مقصر شناخته خواهد شد.

این نگرانیها به هیچ وجه بیمورد نیست.

درسهایی برای ایران و چالشهای فساد سیستماتیک

در زمینههایی با فساد سیستماتیک، مانند آنچه که در ایران سراغ داریم، خطر طراحی آلوده یا دستکاری سیستم هوش مصنوعی بسیار بالاست. دادههای آموزشی که از یک سیستم فاسد استخراج شوند، میتوانند فساد را در قالب الگوریتمهای بهظاهر بیطرف تقویت کنند (جانبداری الگوریتمی). همچنین، دستکاری دادههای ورودی یا فقدان نظارت مستقل هوش مصنوعی را به ابزاری برای تداوم فساد تبدیل میکند، بهویژه اگر چارچوبهای حقوقی و نظارت انسانی قوی وجود نداشته باشد. تحولات اخیر هوش مصنوعی نشان میدهند که بدون شفافیت در طراحی و اجرا، فنآوری ممکن است به جای حل مشکل، به پنهانکاری پیچیدهتر منجر شود.

برای موفقیت چنین سیستمی در محیطهای دارای فساد ساختاری، نیاز به طراحی شفاف، بازبینی مستقل توسط نهادهای بینالمللی و مشارکت جامعه مدنی است. پروژه دیلا، اگر با نظارت دقیق و چارچوبهای حقوقی قوی اجرا شود، میتواند همکاری انسان و هوش مصنوعی را بهعنوان آینده حکمرانی نشان دهد. اما بدون این پیشنیازها، خطر تبدیل هوش مصنوعی به ابزاری برای مشروعیتبخشی به فساد وجود دارد، که این امر در زمینههایی مانند ایران نیازمند توجه ویژه به مکانیزمهای جلوگیری از سوءاستفاده است.

موفقیت یا شکست این پروژه نه تنها برای آلبانی، بلکه برای درک جهانی از قابلیتها، محدودیتها و خطرات واگذاری اختیارات حکومتی به الگوریتمها تعیینکننده خواهد بود. این یک گام بزرگ به سمت آیندهای است که در آن هوش مصنوعی به یک شریک ضروری در مدیریت جامعه تبدیل میشود، اما سؤالات عمیقی درباره اخلاق، مسئولیتپذیری و کنترل انسان بر فنآوری ایجاد میکند.

نظرها

نظری وجود ندارد.