جنگ ایران، هوش مصنوعی و بحران مسئولیت: چه کسی تصمیم مرگ و زندگی را میگیرد؟

واقعیت این است که تنها دولت ترامپ نیست که خواستار استفادهٔ «نامحدود» از هوش مصنوعی است. هوش مصنوعی اکنون وارد میدان جنگ شده است؛ میدانی که هنوز قوانین و قواعد آن نوشته نشدهاند. میدانی بسیار پرسود و خطرناک، با رقابتی فزاینده بین شرکتها، دولتها و کشورها. آیا مسئول کشتارهای ناخواسته الگوریتمها هستند، شرکتهای هوش مصنوعی یا سیاستمدارانی که به آنها تکیه میکنند؟

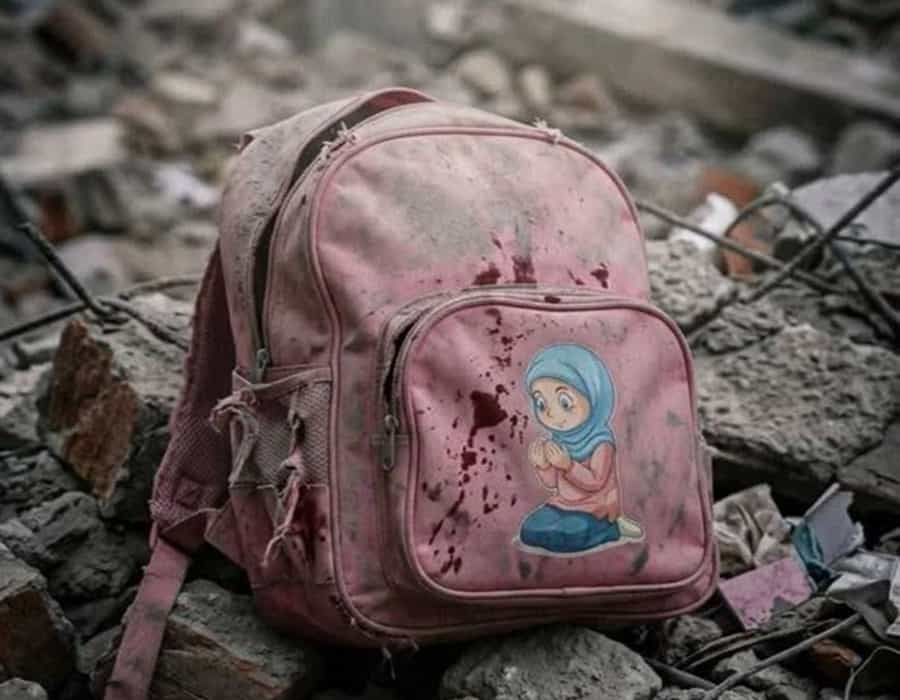

کیف به جا مانده – از تصویرهای پس از بمباران مدرسهای در میناب، ۹ اسفند ۱۴۰۴

حملهٔ اخیر ایالات متحده و اسرائیل به ایران، تنها یک عملیات نظامی نبود؛ بلکه نشانهٔ ورود کامل هوش مصنوعی به قلب تصمیمگیریهای جنگی بود.

در این عملیات، سیستمهای مبتنی بر هوش مصنوعی نقش کلیدی داشتند. در زیر، نگاهی کوتاه به مهمترین جنبهها و تواناییهای آنها میاندازم:

پردازش دادهها: پردازش حجم عظیمی از دادههای بهدستآمده از ماهوارهها، پهپادها و دیگر سیگنالها و تبدیل آن به اطلاعات قابلاستفاده برای دیگر سیستمها.

شناسایی هدف: فرماندهی مرکزی ایالات متحده (CENTCOM) استفاده از ابزارهای پیشرفتهٔ هوش مصنوعی را برای پردازش حجم عظیمی از دادهها تأیید کرده است. سیستم Maven، که توسط مدلهایی مانند Anthropics Claude ساخته شده است، برای شناسایی بیش از ۱۰۰۰ هدف در ۲۴ ساعت اول حمله به ایران مورد استفاده قرار گرفته است [1].

شبیهسازی سناریوهای جنگی و برنامهریزی حملات، و در نهایت ارزیابی نتایج پس از حمله.

سیستمهای تصمیمگیری هوشمند، بر اساس و با پشتیبانی سه مورد بالا، میتوانند بهجای انسان تصمیم بگیرند و اجرا کنند.

به موارد بالا میتوان نکات شناختهشدهتر زیر را افزود:

حملات سایبری: علاوه بر آمریکا و اسرائیل، بازیگران سایبری ایران نیز شروع به استفاده از هوش مصنوعی برای یافتن سریعتر آسیبپذیریها در زیرساختهای حیاتی ایالات متحده کردهاند.

جنگ اطلاعاتی: هوش مصنوعی رسانههای اجتماعی را با «دیپفیک» یا اطلاعات کاملاً دروغین پر میکند و تصاویری از جنگ تولید میکند که باعث سردرگمی و تأثیرگذاری بر افکار عمومی جهانی میشود. البته این نوع جنگ اطلاعاتی نقش چندان پررنگی در جنگ کنونی نداشته است.

اما همانطور که اشاره شد، آنچه این جنگ را متمایز میکند، نه فقط فناوری هوش مصنوعی، بلکه عمق بهکارگیری آن و همچنین شکافی است که میان دولت آمریکا و برخی شرکتهای سازندهٔ این فناوری بهوجود آمده است.

هزینهٔ انسانی؛ وقتی الگوریتمها اشتباه میکنند

منتقدان هشدار دادهاند که اتکای فزاینده به انتخاب اهداف توسط هوش مصنوعی میتواند به افزایش تلفات غیرنظامی منجر شود.

حملهٔ موشکی آمریکا به مدرسهٔ میناب که جان بیش از ۱۶۰ کودک را گرفت، از شاهکارهای هوش مصنوعی بود یا خطای انسانی؟ شاید هم هر دو. پاسخ به این سؤال کوچکترین مرهمی بر داغ این خانوادهها نیست و از مسئولیت تصمیمگیرندگان اصلی کم نمیکند. اما در خوشبینانهترین حالت، شاید بتواند تلنگری دیگر باشد بر ذهنها و انسانهای هنوز بیدار و مسئول، دربارهٔ آیندهٔ این نوع بهکارگیری.

و باز این سؤال پررنگتر میشود که اگر الگوریتم در انتخاب هدف نقش اساسی دارد، مسئولیت نهایی با چه کسی است؟ سازندگان الگوریتمها یا کسانی که بیش از حد به آنها اعتماد میکنند؟

کشمکش بین شرکتهای هوش مصنوعی و دولت ترامپ

اختلاف از جایی آغاز شد که پنتاگون خواهان دسترسی کامل به مدلهای هوش مصنوعی برای «تمام کاربردهای قانونی» شد. این در عمل یعنی استفاده در نظارت گسترده و بهکارگیری در سامانههای تسلیحاتی که بخشی از تصمیمگیری مرگ و زندگی را به الگوریتمها واگذار میکنند.

اما شرکت Anthropic این درخواست را رد کرد و اعلام کرد که استفاده از هوش مصنوعی در «نظارت گسترده» و «کاربردهای مرگبار بدون کنترل کافی انسانی» خط قرمز این شرکت است [2].

این اختلاف پس از ماهها مذاکره به بنبست رسید.

وزیر جنگ آمریکا، پیتر هگست Pete Hegseth، این موضع را بهشدت مورد انتقاد قرار داد و تهدید کرد که این شرکت با پیامدهای جدی مواجه خواهد شد [3][4].

واکنش دولت: برچسبزنی و حذف

پس از شکست مذاکرات، دولت آمریکا اقداماتی بیسابقه انجام داد. شرکت Anthropic را در فهرست سیاه قرار داد و همکاری با این شرکت را بهعنوان خطری در زمینهٔ تأمین مواد معرفی کرد. «ریسک زنجیرهٔ تأمین» (Supply chain risk) برچسبی است که معمولاً برای تهدیدهای خارجی بهکار میرود [5]. سپس ترامپ دستور داد تمامی نهادهای فدرال استفاده از فناوری این شرکت را متوقف کنند [6].

اما جالب اینجاست که با وجود این محدودیتها، وابستگی ارتش به این فناوریها بهگونهای است که کنار گذاشتن کامل آنها بهسادگی ممکن نیست [7].

ورود OpenAI: همکاری بهجای تقابل

در حالی که این بحران در حال تشدید بود، شرکت OpenAI که با ChatGPT شناخته میشود، مسیر متفاوتی را انتخاب کرد. پس از کنار گذاشته شدن Anthropic، پنتاگون بهدنبال جایگزینهایی از جمله OpenAI و دیگر شرکتها رفت [8]. این شرکت، علیرغم جانبداری نخستین از خط قرمزهای Anthropic، به دعوت ترامپ لبیک گفت.

این عمل باعث شد برخی تحلیلگران این روند را نوعی «فرصتطلبی استراتژیک» بدانند. در لحظهای که یک شرکت بر محدودیتها پافشاری میکرد، شرکت رقیب گوی را زد و برد و همکاری با دولت را پذیرفت.

تفاوت رویکردها روشن بود:

Anthropic تلاش کرد پیش از استفاده، چارچوب تعیین کند.

اما OpenAI همکاری را پذیرفت و اعلام کرد حل موارد اختلاف را به بعد موکول میکند. نه گفتن به سرمایهگذاریهای عظیم نظامی کار سادهای نیست.

این تنش اکنون به دادگاه کشیده شده است. Anthropic با شکایت از دولت آمریکا، دولت را متهم کرده که بهدلیل مواضع این شرکت در زمینهٔ ایمنی هوش مصنوعی علیه آن اقدام کرده است؛ مواضعی که از آغاز خط قرمز شرکت برای استفاده در صنایع نظامی بودهاند. غیرقانونی اعلام کردن احکام ترامپ پدیدهٔ جدیدی نیست، اما این از پیچیدگی نقش و آیندهٔ هوش مصنوعی کم نمیکند.

پایان سخن: الگوریتم یا انسان، پاسخگویی هست؟

آنچه امروز در حال شکلگیری است، تنها یک اختلاف میان دولت و یک شرکت فناوری نیست. این یک کشمکش بنیادین بر سر کنترل قدرتمندترین ابزار قرن بیستویکم است.

پنتاگون خواهان کنترل کامل است. افکار عمومی و برخی شرکتها خواهان محدودیت و نظارت. (اشاره به این واقعیت جالب است که پس از درگیری بین دولت آمریکا و Anthropic، که نزد افکار عمومی با هوش مصنوعی Claude شناخته میشود، میزان استفادهکنندگان از Claude نسبت به ChatGPT پیشی گرفت.)

واقعیت این است که تنها دولت ترامپ نیست که خواستار استفادهٔ «نامحدود» از هوش مصنوعی است. هوش مصنوعی اکنون وارد میدان جنگ شده است؛ میدانی که هنوز قوانین و قواعد آن نوشته نشدهاند. میدانی بسیار پرسود و خطرناک، با رقابتی فزاینده بین شرکتها، دولتها و کشورها.

پرسش اصلی دیگر این نیست که آیا از این فناوری استفاده خواهد شد یا نه؛ این اتفاق همین حالا در حال رخ دادن است.

آیا مسئول کشتارهای ناخواسته الگوریتمها هستند، شرکتهای هوش مصنوعی یا سیاستمدارانی که به آنها تکیه میکنند؟

اما شاید این هم حتی سؤال اصلی نباشد.

پرسش واقعی این است:

وقتی تصمیمگیری به ماشینها واگذار شود، آیا هنوز انسانی برای پاسخگویی باقی میماند؟

و در نهایت: چه کسی این قدرت را کنترل میکند، و با چه هزینهای؟

پانویس:

[1] Reuters — Pentagon to adopt Palantir AI as core system; role of Maven in targeting

[2] The Guardian — Anthropic draws red lines on military AI use (surveillance, lethal autonomy)

[4] The Guardian — Hegseth criticizes Anthropic stance; escalating dispute

[5] Business Insider — “Supply chain risk” designation and judge skepticism

[6]Breaking Defense — Trump administration order halting use of Anthropic technology

[7] Reuters — Military dependence on AI systems despite policy tensions

[8] Wired — Judge: Pentagon move may be punitive; shift toward alternative AI providers

نظرها

نظری وجود ندارد.